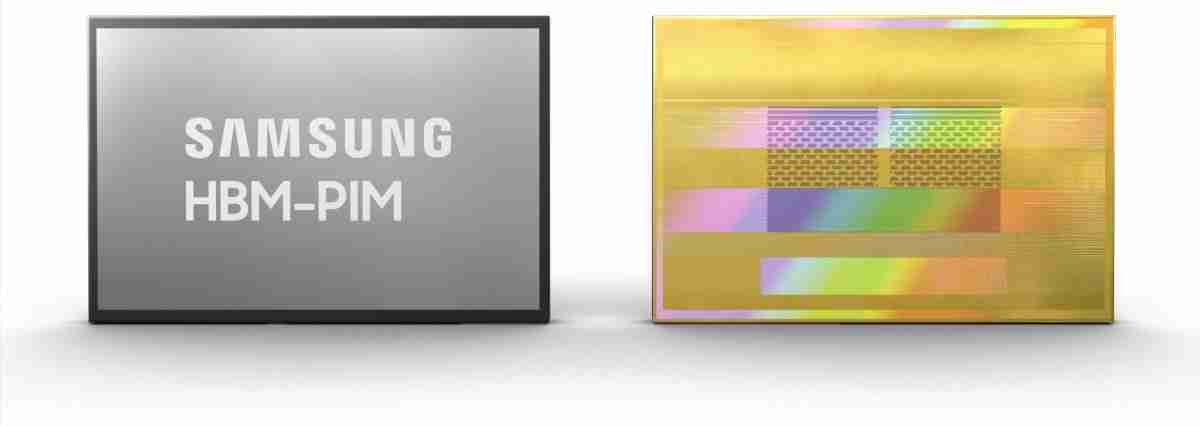

处理单元(CPU,GPU或其他)和RAM通常是在单独的芯片上采用的东西。但如果他们是同一芯片的一部分,怎样混合在一起?这正是三星创建世界上第一个高带宽内存(HBM)的内置AI处理硬件,称为HBM-PIM(用于处理内存)。

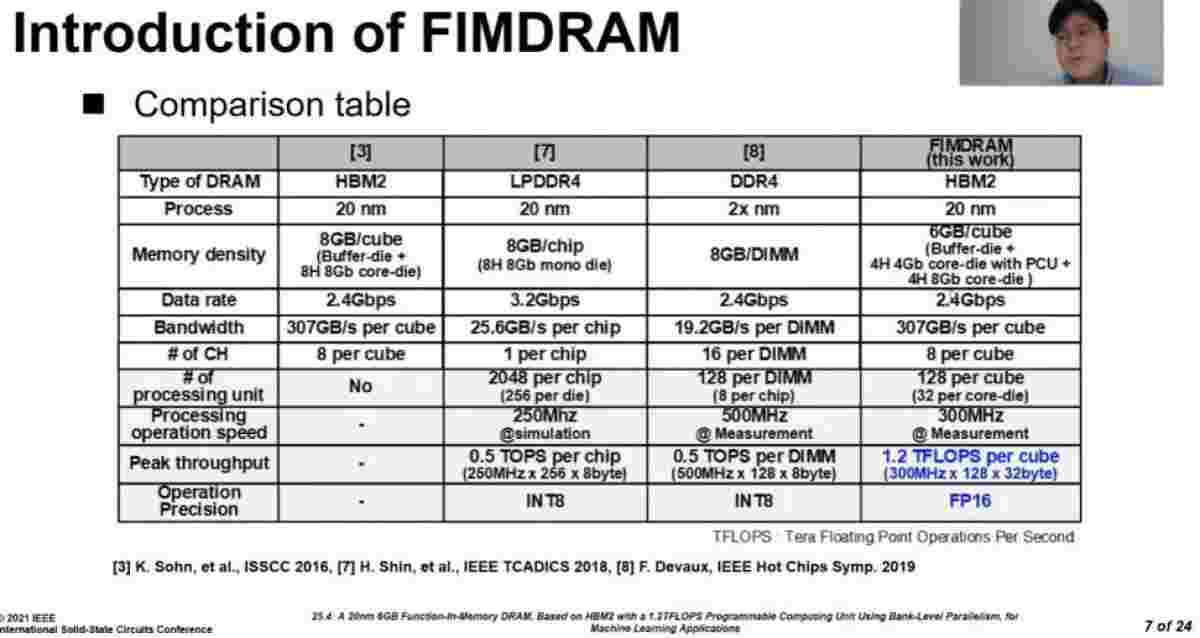

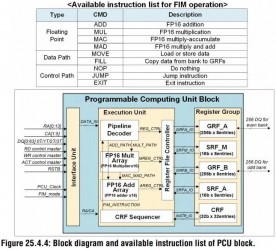

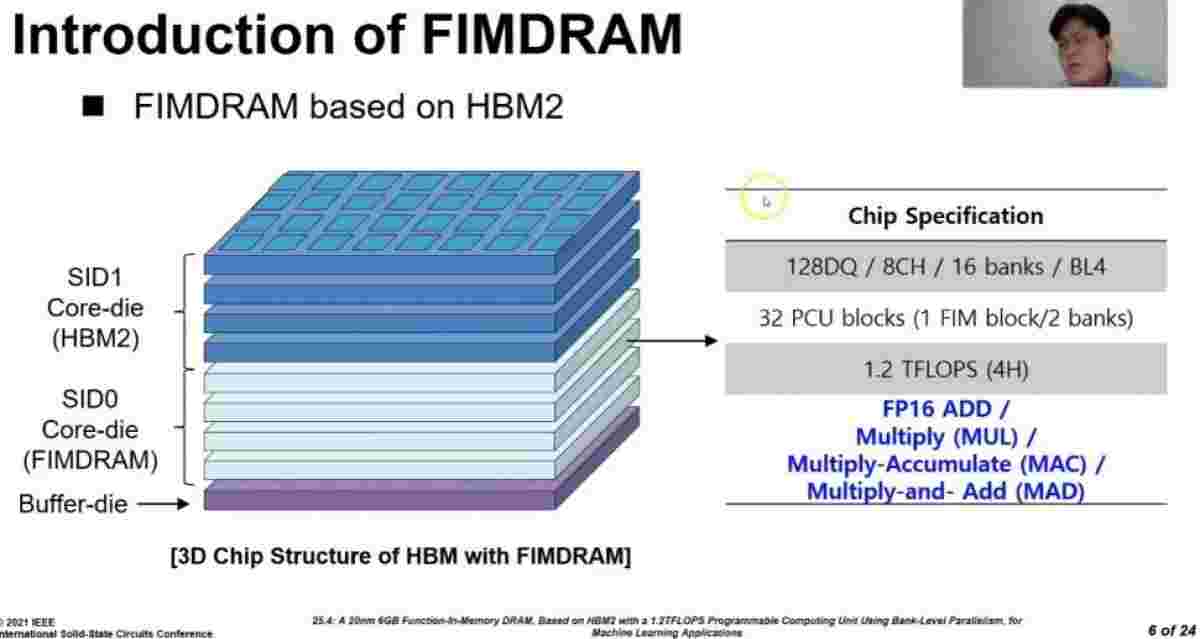

它拍摄了其HBM2 Aquabolt芯片,并在内存库之间添加了可编程计算单元(PCU)。这些相对简单,并在具有有限指令集的16位浮点值上操作 - 它们可以移动数据并执行乘法和添加。

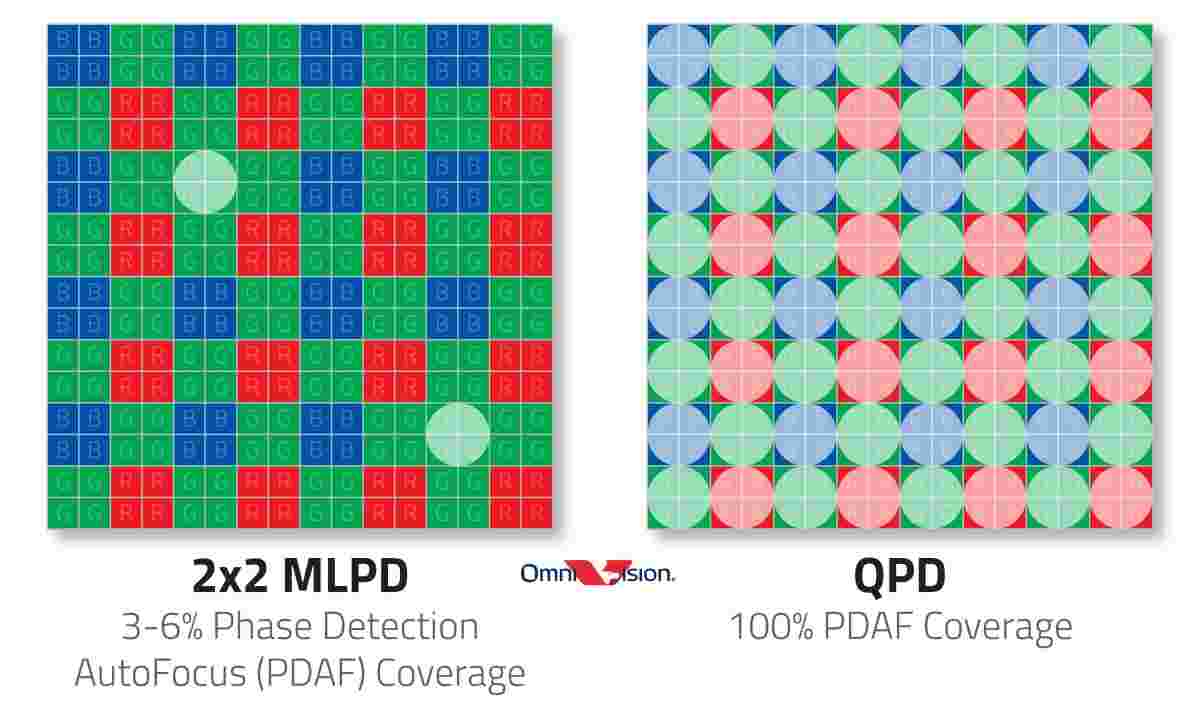

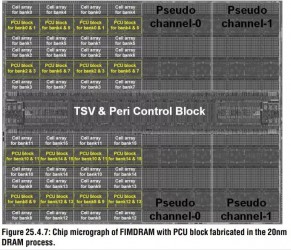

PCU与内存库混合使用•PCU是一个非常有限的FP16处理器

PCU与内存库混合使用•PCU是一个非常有限的FP16处理器

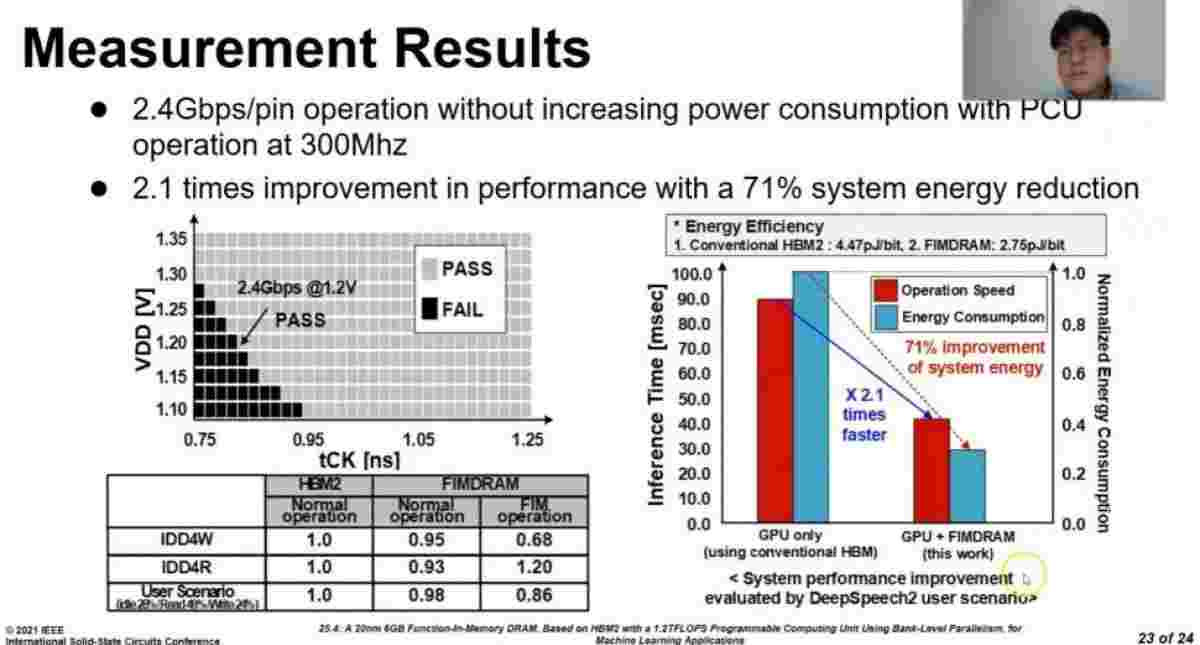

但是有许多PCU,他们实际上坐在他们正在努力的数据旁边。三星设法获得300 MHz工作的PCU,该PCU为每芯片的1.2 TFLOPS处理电源。它使电源使用(每芯片)相同,同时将数据以2.4 Gbps传输到每个引脚。

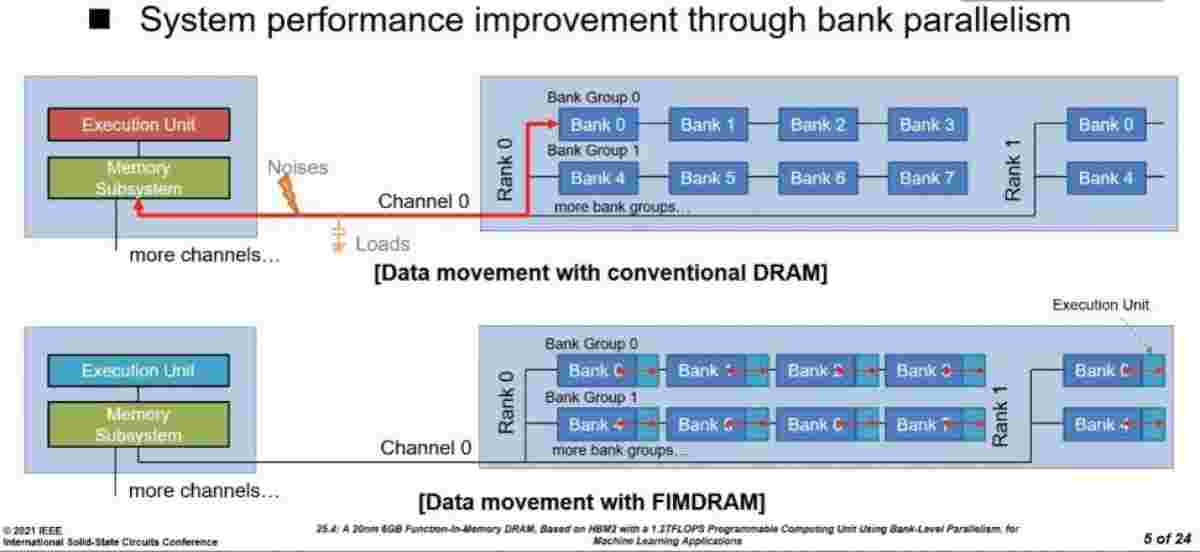

每芯片电源使用可能是相同的,但整体系统能耗下降71%。这是因为典型的CPU需要移动数据两次 - 读取输入然后写出结果。使用HBM-PIM,数据并不真正去任何地方。

这不仅仅是省电,使用PIM用于机器学习和推理任务研究人员看到系统性能多倍。这是一个双赢的局面。

HBM-PIM设计向后兼容常规HBM2芯片,因此不需要开发新的硬件 - 该软件只需告诉PIM系统将从常规模式切换到内存处理模式。

这个问题有一个问题,它是PCUS以前由内存银行占用的空间。这将总容量减半至4千兆位。三星决定分开差异,将4千兆位PIM芯片与8千兆位常规HBM2模具相结合。使用每个它的四个创建了6个千兆字节堆栈。

有一些不好的消息 - 在消费者硬件中的HBM-PIM落地前将是一段时间。目前,三星已经发出了由伙伴开发AI加速器的合作伙伴测试的芯片,并预计将在7月份验证设计。

HBM-PIM本周将在国际固态电路虚拟会议上呈现,所以我们可以期待更多细节。